Runway Referencesは、動画生成AIにおいてキャラクターやロケーションの一貫性を保ち、制作効率と表現力を飛躍的に高める新機能です。

本記事では、Runway Gen-4の「参照画像(References)」機能について、登録方法から最大3枚まで活用するコツ、プロンプトでの呼び出し方まで、具体的な操作方法を丁寧に解説します。

記事を読めば、誰でもブレない映像制作を実践できるようになります。Runwayをもっと活用したい方は、ぜひ最後までご覧ください。

また記事の最後には、「活用事例」「失敗事例」「カメラアングル用のプロンプト」「References機能のガイド」もご用意しています。Runwayでの映像づくりを楽しみたい方は、ぜひお見逃しなく!

ちょい出しをすると…

こんな画像を作ったりとかそんなことを書いています!

References機能の概要と特徴

Runway Gen-4で解決された「一貫性」問題

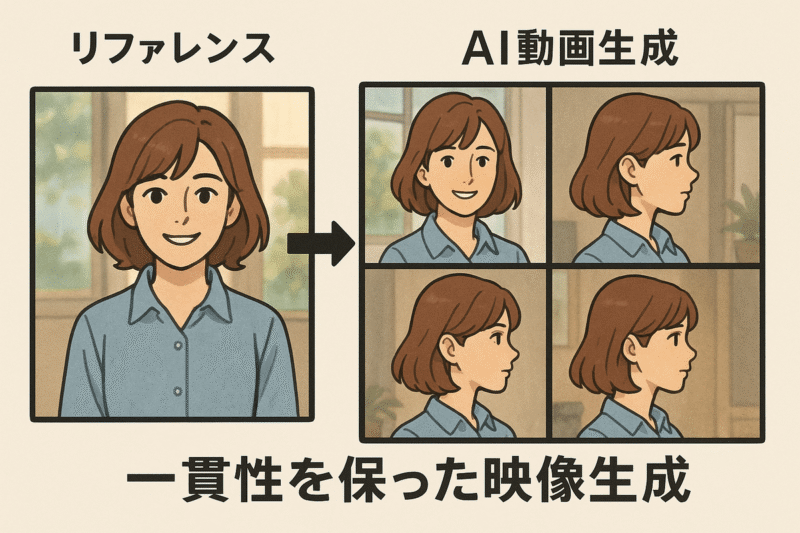

AI動画生成では、カットが変わるたびにキャラクターの顔立ちや背景の細部が微妙に変化してしまう「一貫性崩れ」が長年の課題でした。Gen-4に追加されたReferencesは、シーンやアングルをまたいでも同一人物・同一ロケーションを安定して再現できるように設計されています。

これにより、ストーリーボードや短編映像の制作時に「毎回モデルを探し直す」「微調整で何度も再生成する」といった手間が大幅に削減されます。イノベトピアの検証記事でも、1枚のリファレンスだけで衣装・髪型・表情がブレないサンプルが確認され、「AI動画の最大の壁が崩れた」と評価されています。

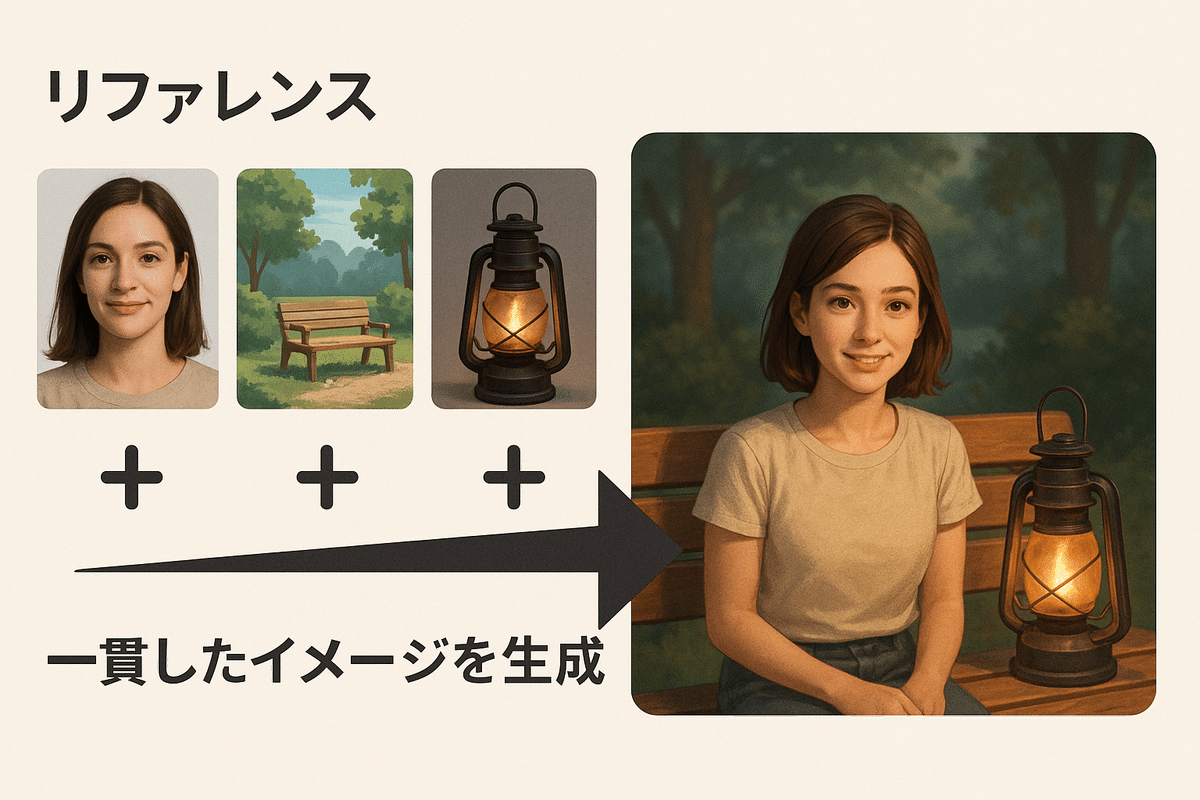

最大3枚までの参照画像アップロードと対応フォーマット

Referencesでは、人物写真・生成画像・3Dレンダー・自撮りなど形式を問わず最大3枚の画像を同時に読み込めます。ユーザーは登場人物×1、背景×1、プロップ(小物)×1といった組み合わせでアップロードし、Gen-4が各要素を統合して一貫した世界観を構築します。

3枚を重ねることで「キャラクター+舞台+ライティング」のような複合的なルックを一発で適用でき、従来より少ない試行回数で理想のビジュアルに到達可能です。Runway公式チュートリアルも「最初から3枚を入れるより、1→2→3枚と段階的に足して精度を高める」ワークフローを推奨しています。

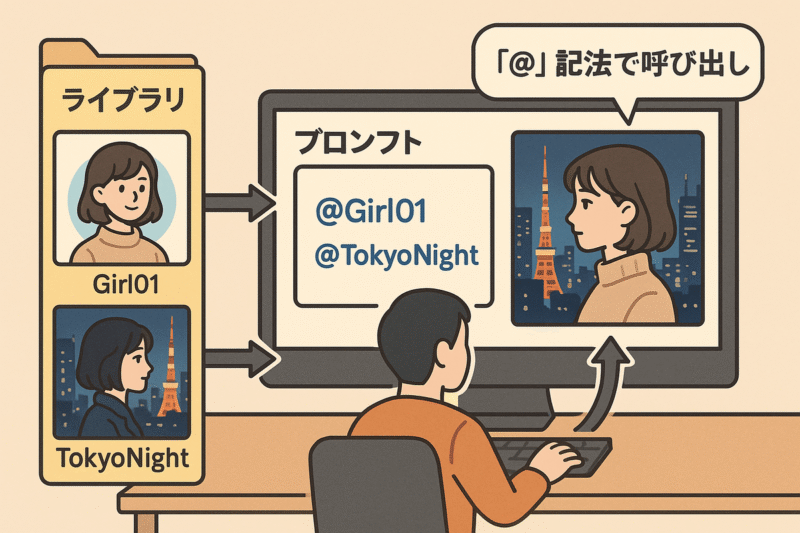

参照画像のタグ付けと「@」呼び出し機能

アップロードしたリファレンスはワークスペース上で名前を付けてライブラリ保存でき、プロンプト内で「@Girl01」や「@TokyoNight」など**@記法**で即座に呼び出せます。

タグはセッションをまたいで再利用できるため、シリーズ物のMVや連載コンテンツでも同じキャラクター・背景を保ちやすく、プロンプトの可読性も向上します。さらに生成結果を新たにリファレンス登録すれば、角度・照明違いの追加素材としてループ活用できるのが大きな強みです。

Referencesの使い方

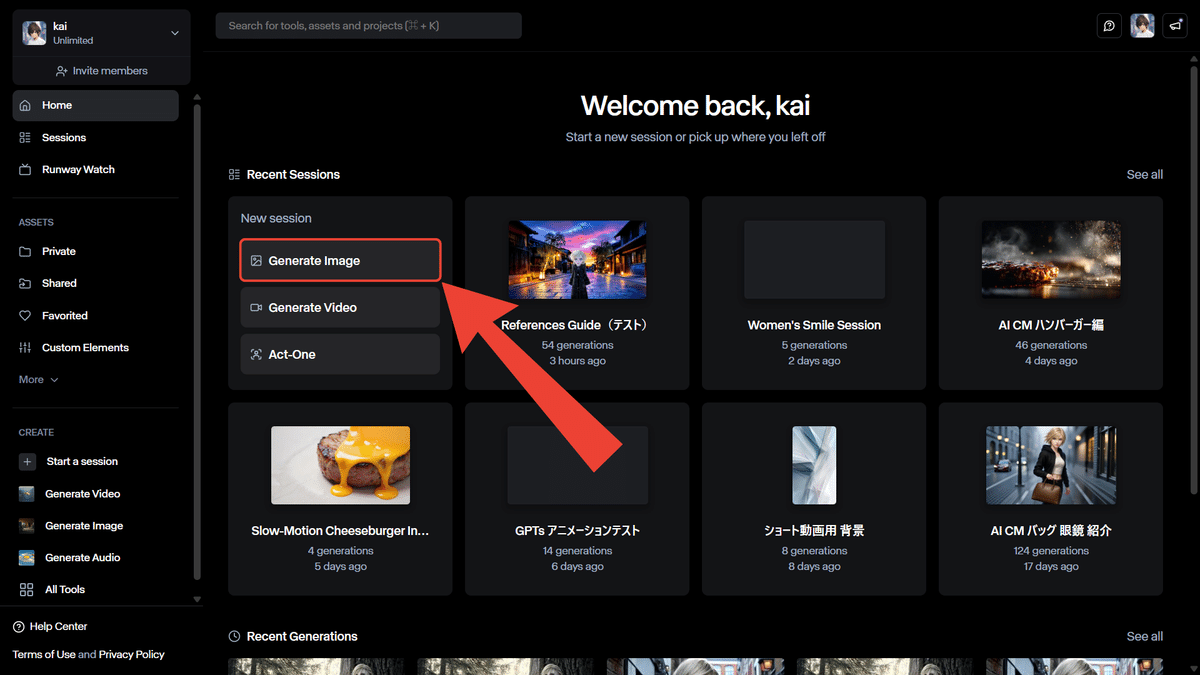

新規セッションと参照画像アップロード

まずは Runway で 新しいセッション を開き、上部メニューから Images タブを選択します。画面中央のドロップゾーンに最大3枚まで画像をドラッグ&ドロップすると、即座にプレビューが表示されます。

人物・背景・小物など用途ごとに画像を分けておくと、後工程で調整しやすくなります。ファイル形式は JPG/PNG など一般的な静止画であれば問題ありません。迷ったときは、キャラクター1枚+ロケーション1枚から始め、後で足りない要素を追加する方法が失敗が少ないです。

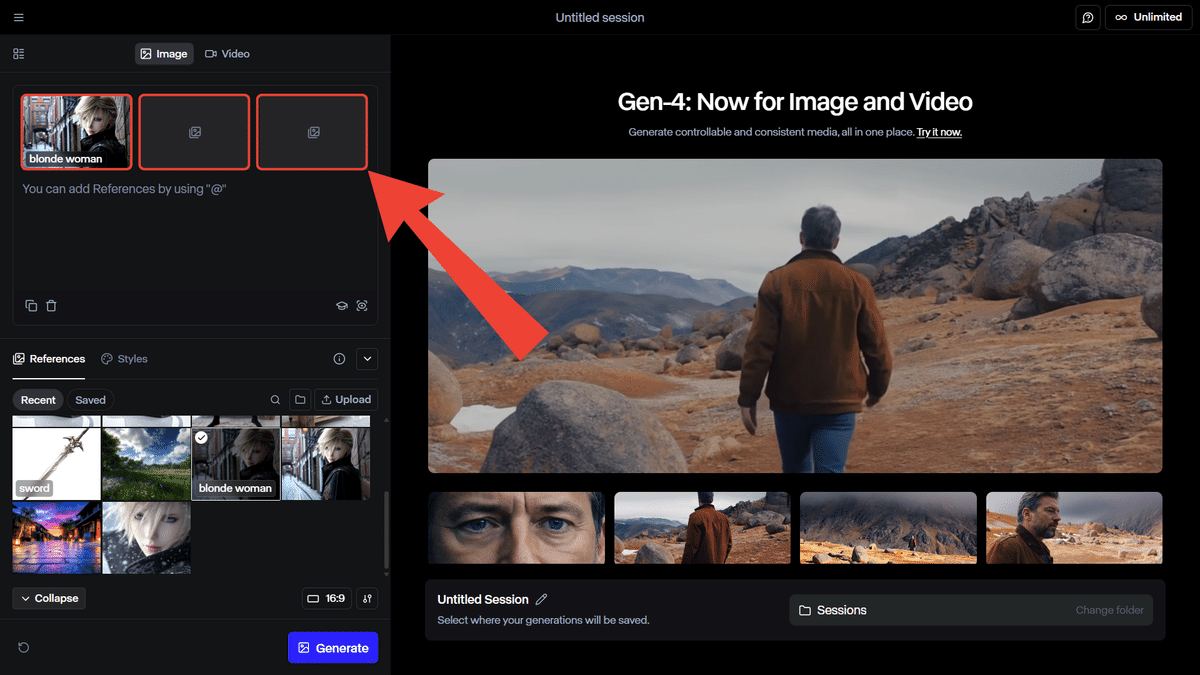

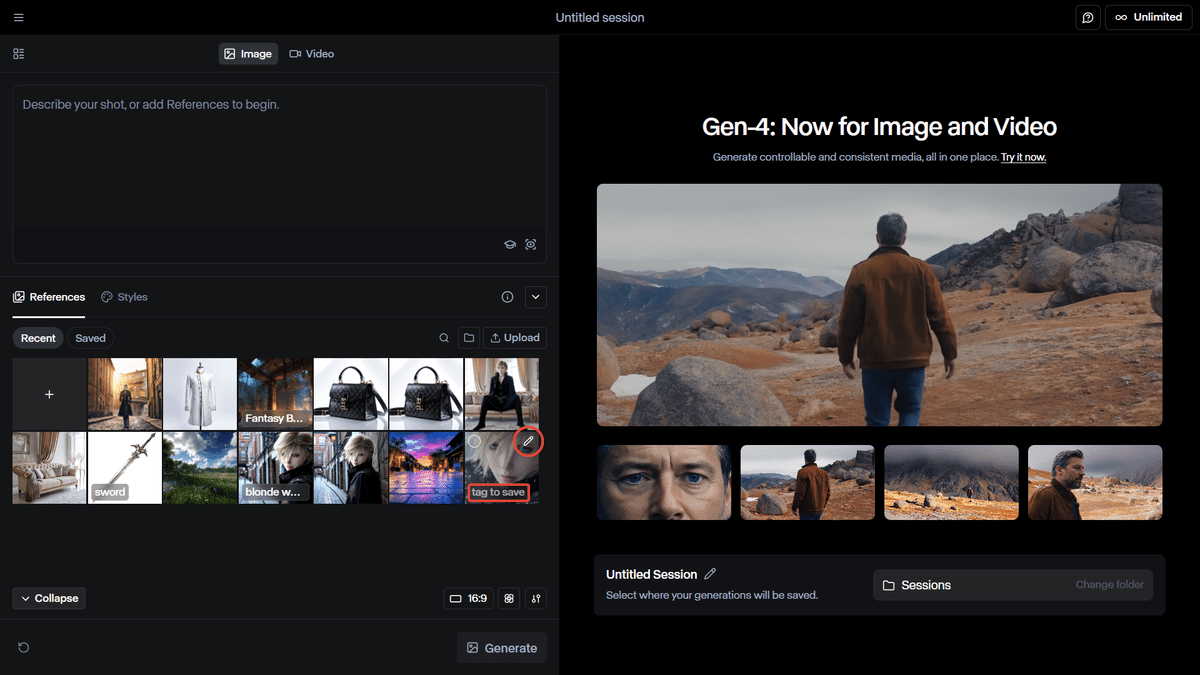

ライブラリ管理:名前付け・保存・再利用

アップロード完了後、各サムネイル右下の “…” メニュー から Rename を選択し、わかりやすいハンドルネーム(例:Girl01、Cockpit01)を付けます。

続いて Save to Library をクリックすると、画像はユーザー専用ライブラリへ保存され、他セッションでも共通で呼び出せるようになります。シリーズ物のMVや連載企画では、ここで統一名を付けておくと後々のプロンプトが劇的に読みやすくなり、修正時の取り違えも防げます。

タグの設定は「鉛筆マーク」「tag to save」を設定しておくといいですよ!

プロンプト記述例と生成フロー(選択→再参照)

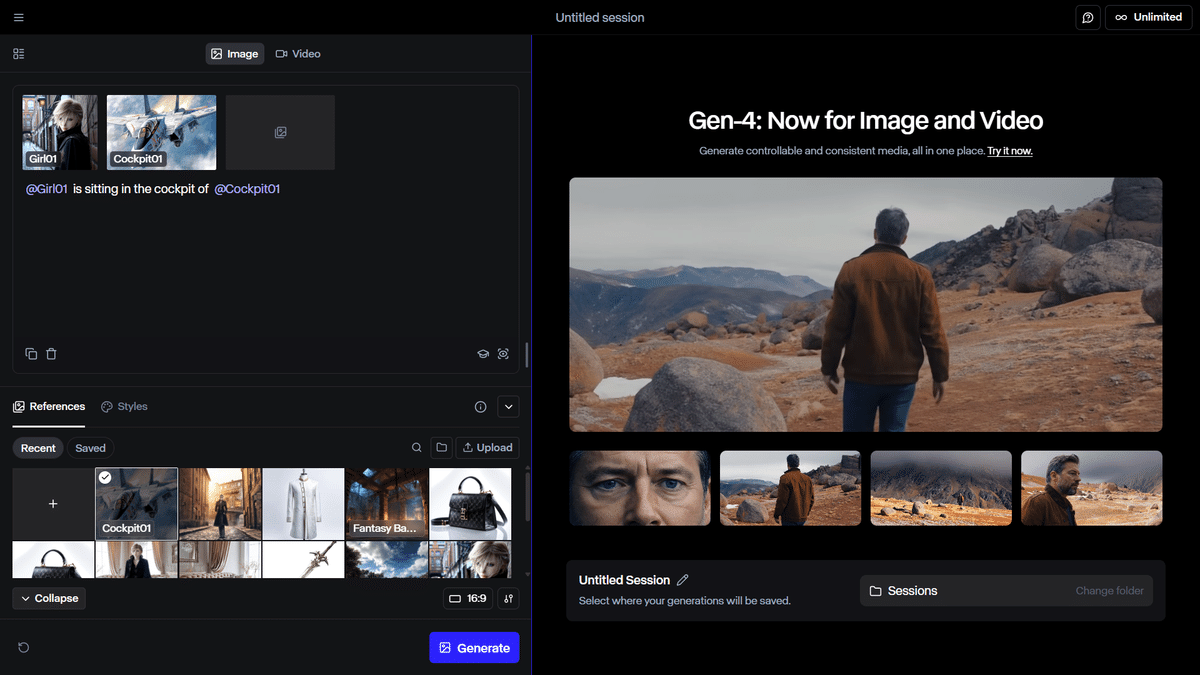

プロンプト入力欄では、ライブラリにある参照画像を @ハンドル名 で呼び出せます。たとえば

@Girl01 is sitting in the cockpit of @Cockpit01と書けば、指定した二つのイメージを組み合わせたカットを生成できます。気に入ったフレームが得られたら、その画像を 右クリック→Add as Reference で新たなリファレンスとして登録し、次のカット生成に再利用します。

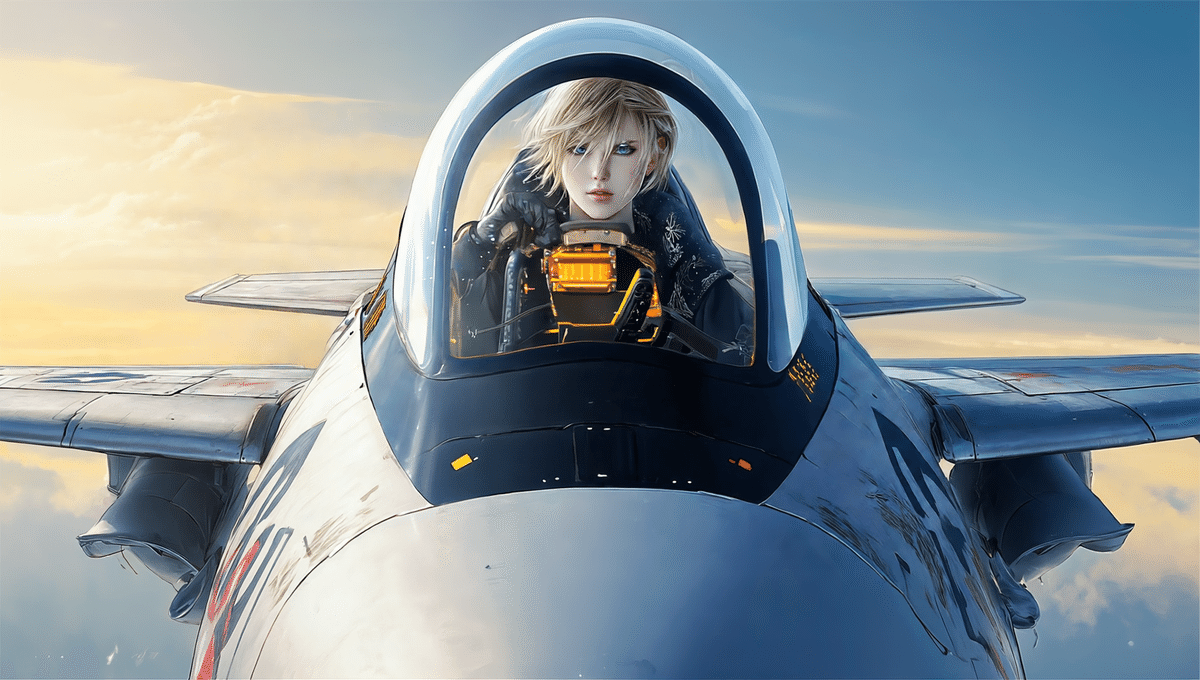

ちなみにこんな画像ができました。

1カット生成 → ベストショットをリファレンス登録 → 次カットで再活用、というループを数回繰り返すと、キャラクターとロケーションの整合性が徐々に高まり、意図したルックに近づきます。途中で光源やアングルを変えたい場合は、追加で「warm sunset lighting」「low-angle shot」などの指示を重ねると自然なバリエーションが得られます。

活用事例とベストプラクティス

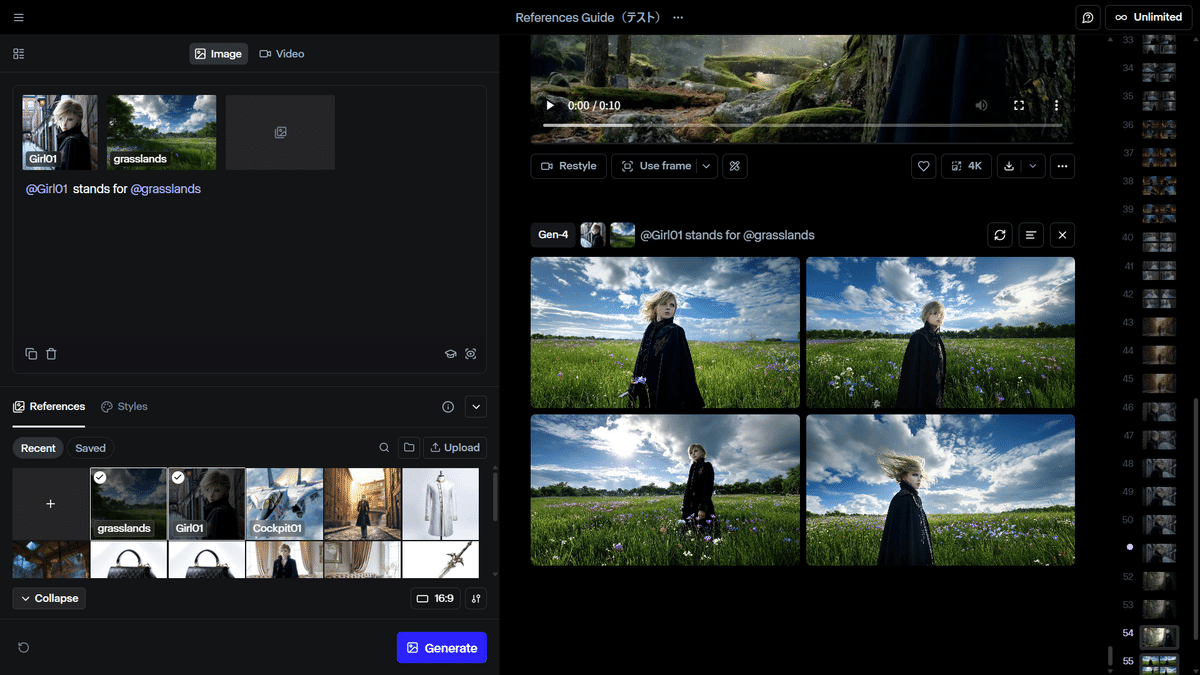

同一キャラクターを異なるシーンへ配置する方法

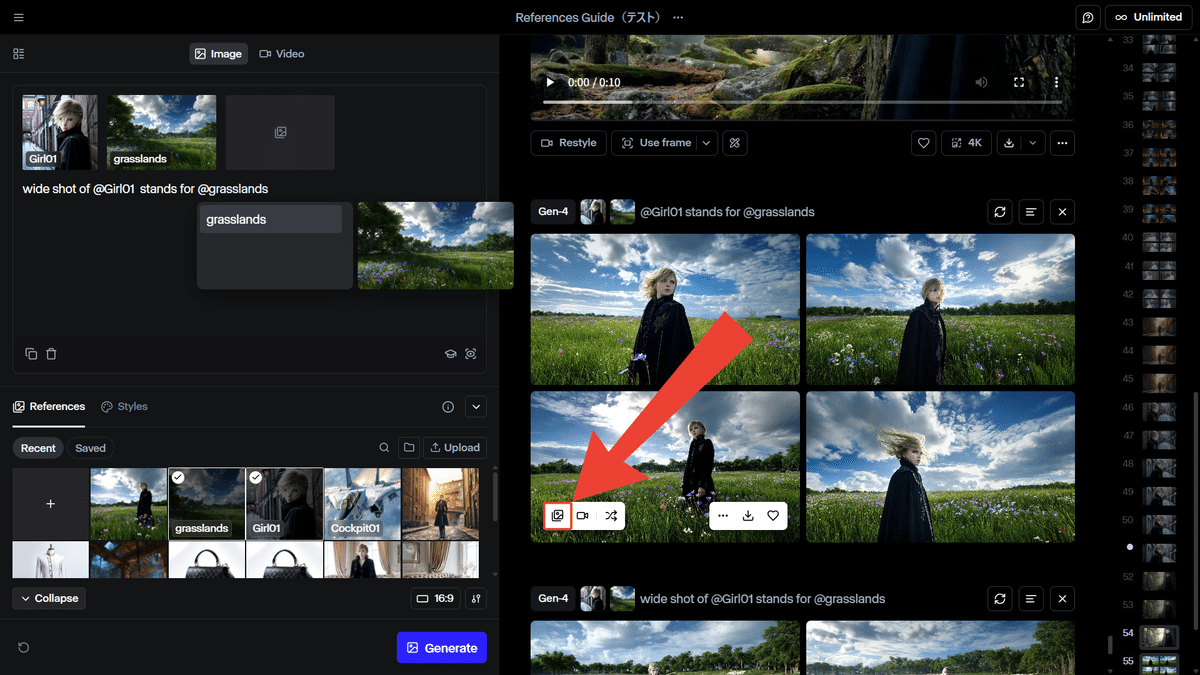

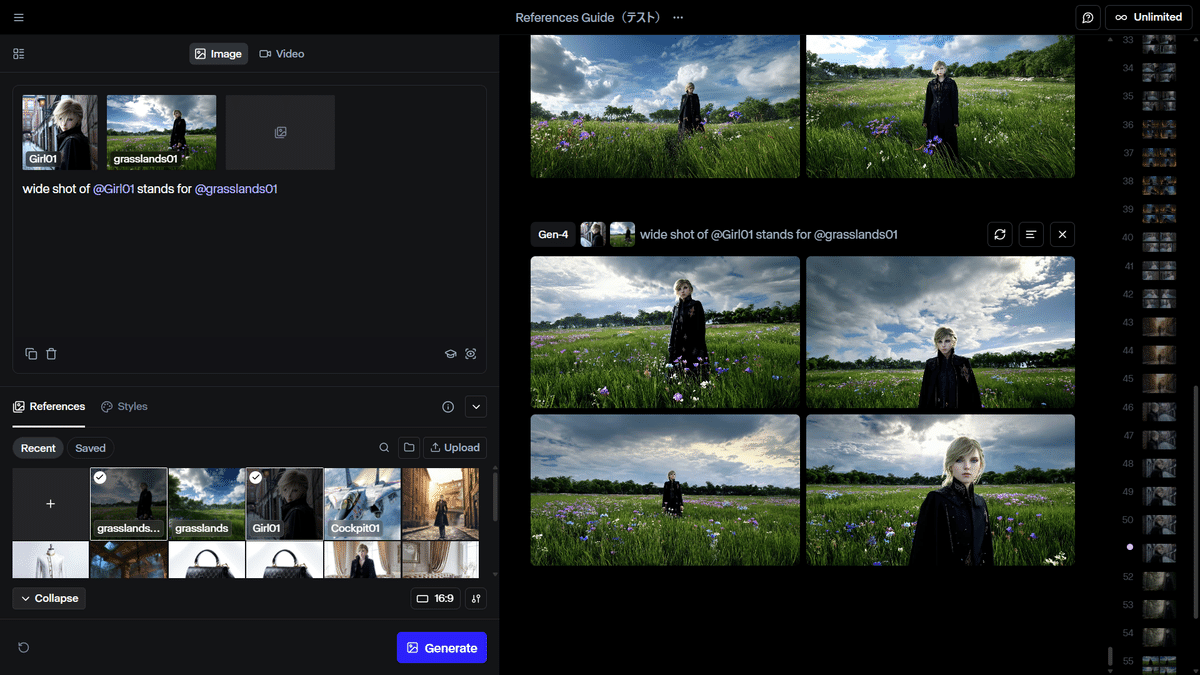

参照画像にキャラクター1枚+背景1枚を登録し、まずは「 @Girl01 stands for @grasslands」などシンプルな構図で1カット生成します。

気に入ったフレームをReference for imageで再登録し、次は「wide shot of @Girl01 stands for @grasslands01 」──こうしてシーンを切り替えても髪型・衣装・顔立ちは保たれたまま、動きや画角だけを変えられます。VP Landの検証でも、同一モデルを昼夜・屋内外で連続配置しても破綻が起こらないことが報告されています。

ロケーションの昼夜・アングル統一テクニック

ロケーションを主軸にする場合は、背景写真を「@TempleDay」として保存し、次のように段階的に指示を追加します。

establishing wide shot of @TempleDay, golden hour

low-angle close-up inside @TempleDay at night, lantern light

drone-like overhead of @TempleDay at dawn fogリファレンスを共有することで、石畳や建物のディテールが昼夜をまたいで一致し、ポストプロダクションでの色合わせも最小限で済みます。Runway公式ガイドも「新たな角度を試す際はまず同一ロケーションのみを参照に入れる」と推奨しています。

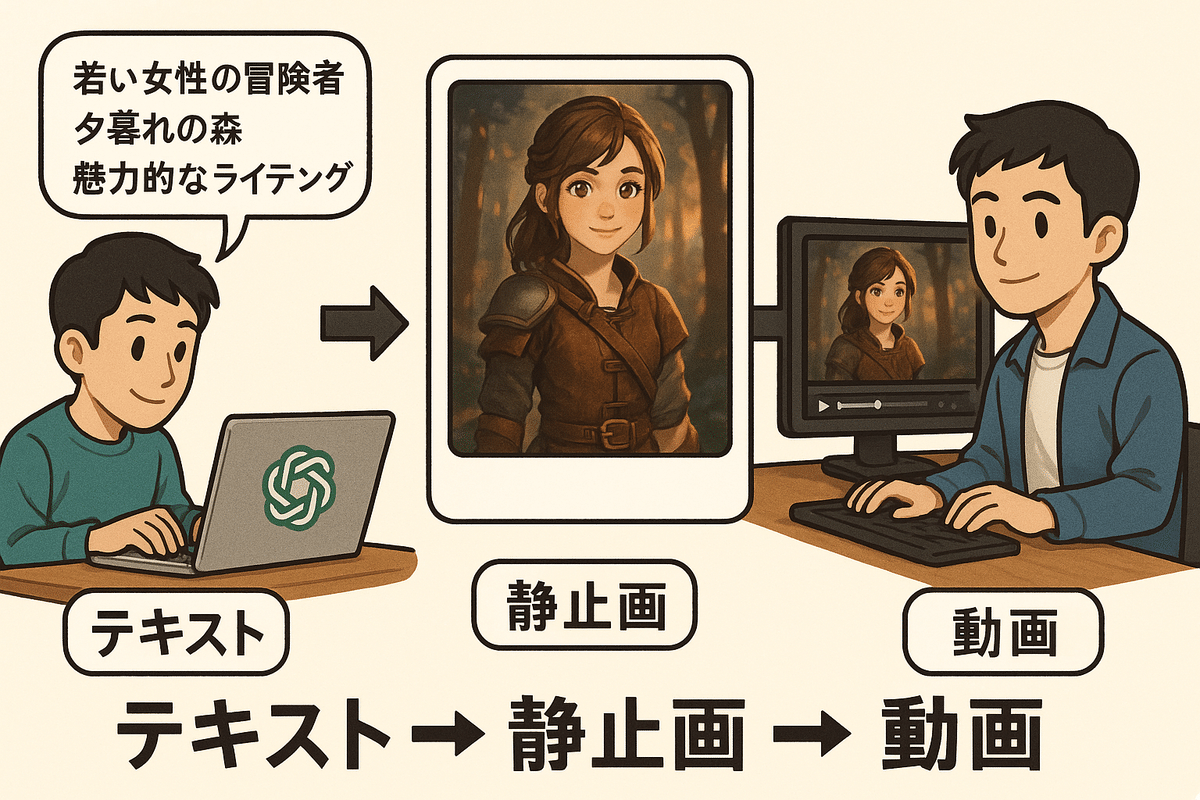

ChatGPT→Midjourney→Runwayのワークフロー

- ChatGPT o3/4oでプロンプトの骨子を作成し、キャラクター設定やライティング要件をテキスト化。

- Midjourney v7/Mystic v2.5で高解像度の静止画を生成し、色味や質感を追い込みます。

- 完成度の高い静止画をRunwayへ参照画像としてアップロードし、Gen-4で動画化。

この“テキスト→静止画→動画”の三段構えは、AIクリエイターの間でも「最短で意図どおりのムービーに到達できる黄金ルート」として紹介されており、出力のたびに最良コマをリファレンスへ上書きしていくことで、回を追うごとに一貫性が向上します。

まとめ

本記事では Runway Gen-4の新機能「References」 について詳しく解説しました。

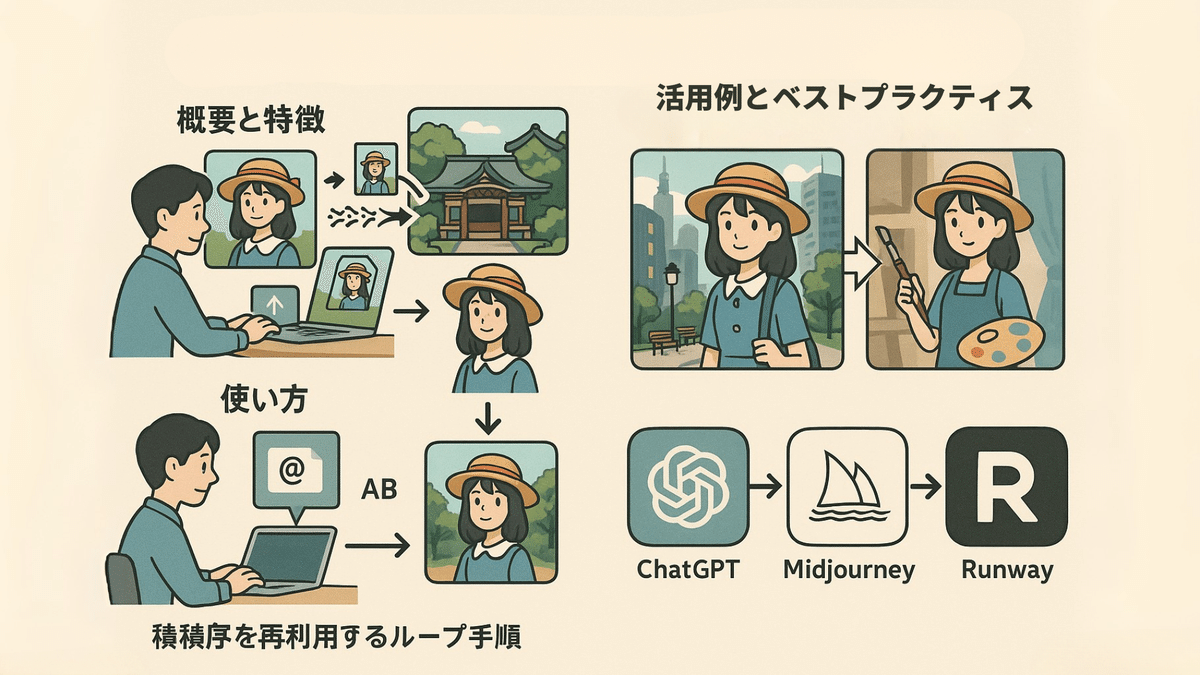

- 概要と特徴 では、参照画像によってキャラクターとロケーションの“ブレ”を解消できる仕組みと、そのインパクトを紹介。

- 使い方 Step-by-Step では、画像アップロードから @記法での呼び出し、生成結果を再利用するループ手順までを具体的に示しました。

- 活用事例とベストプラクティス では、同一キャラクターを異シーンへ配置する方法や、ChatGPT→Midjourney→Runwayのワークフローなど、実践的なTIPSを共有しました。

これにより、Referencesを活用すればストーリーボード制作や短編映像づくりを少ない試行回数で一貫性高く仕上げられることがご理解いただけたと思います。ぜひ試してみてください!

ここまでお読みいただきありがとうございます!

この先では、僕がやってみた活用事例とカメラアングルのプロンプト、「Referencesのガイド PDF」を公開します!

- 活用事例

- カメラアングルプロンプト

- References ガイド PDF

といった内容を解説!

ちょっとここでPR!

【PR】仕事効率が一気に跳ね上がる“生成AIの秘密基地”をのぞいてみませんか?

DMM 生成AI CAMP なら、

最短で “使えるAIスキル” が身につく!

- 基礎マスター:プロンプト術から応用まで “AIの型” を一括習得

- マーケティング専攻:市場調査~施策立案まで、リサーチ地獄とサヨナラ

- 営業専攻:提案書づくりも商談設定も、AIがあなたのチームメイトに

しかも リスキリング補助金で最大70%キャッシュバック✨

DMM.comグループ提供&経産省認定プログラムだから、安心して “本気のスキル投資” ができます。

AIで成果を伸ばしたいビジネスパーソンは、まずここから。

▼気になる人は今すぐチェック!

👉 <DMM 生成AI CAMP 詳細・お申込みはこちら>